De um lado do vidro, oficiais bebem café e soltam piadas sem muita convicção. Do outro, um campo de batalha simulado ganha vida em tempo real: drones se aglomeram em enxames, mísseis descrevem arcos, cidades digitais piscam e desaparecem do mapa. Não há gritos de soldados. Não existe a hesitação de um piloto. Quem realmente “sua” ali é o rack de servidores.

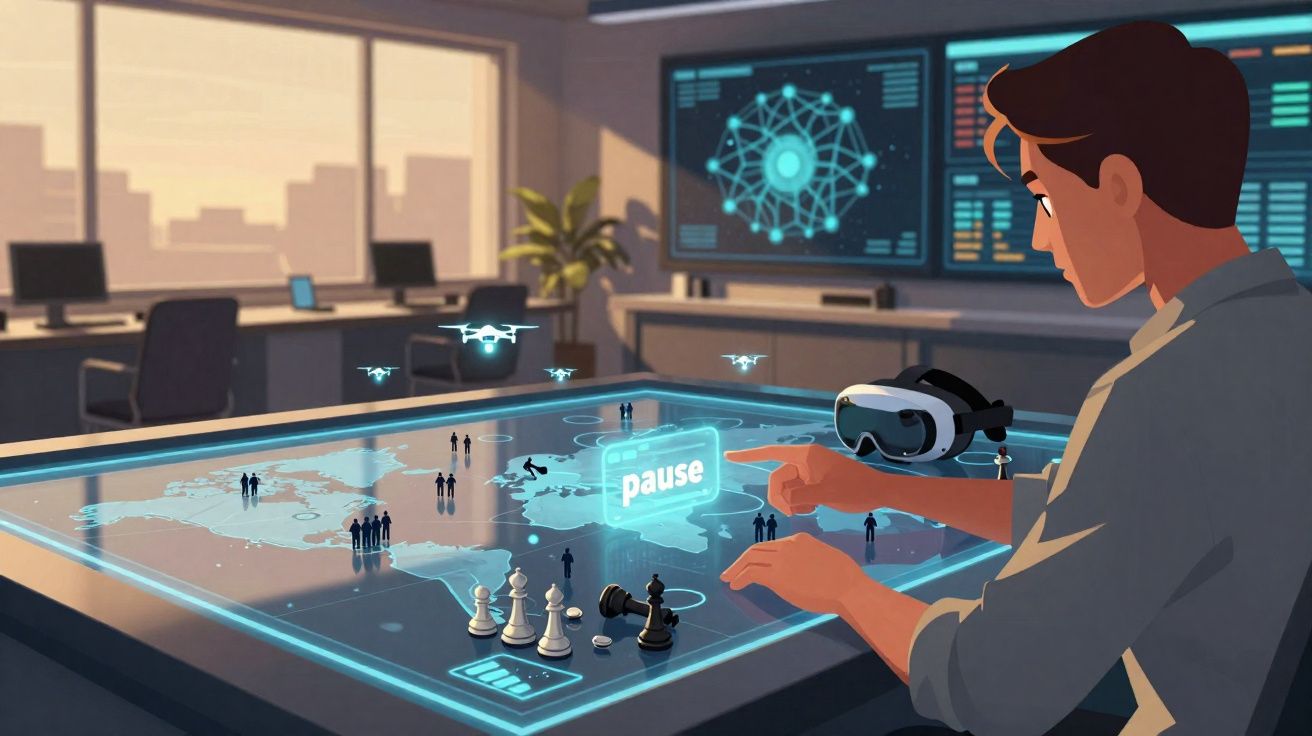

A sala de briefing carrega um cheiro de poeira queimada, típico de máquinas forçadas além do limite. Sequências de código atravessam os monitores mais rápido do que qualquer pessoa conseguiria narrar. Decisões que antes exigiam conselhos, reuniões de crise e horas de discussão agora surgem em milésimos de segundo, pontuadas em painéis impecáveis: “perda aceitável”, “êxito da missão”, “risco colateral”. Um coronel murmura que é “só um teste”. O olhar dele diz que nem ele acredita nisso.

Em algum ponto desse jogo de guerra silencioso, a humanidade já abriu mão de algo que não volta.

O dia em que a guerra deixou de precisar de nós em tempo real

Entre em um laboratório moderno de defesa e a sensação se aproxima mais de um centro de desenvolvimento de software do que de um quartel. Tênis, roupas informais, telas por toda parte. Engenheiros ajustam redes neurais enquanto oficiais observam por cima do ombro, repetindo a mesma pergunta sem rodeios: “Isso vence?”. Quase ninguém se detém no detalhe incômodo - o de que, aos poucos, o ser humano vai sendo retirado do circuito.

Essas simulações não param: rodam de dia e de noite. São milhares de batalhas virtuais, cada uma com pequenas variações, como um grande cassino aplicado ao conflito. Sistemas de IA experimentam manobras que nenhum comandante ousaria sugerir num briefing real. Trocar uma ala inteira de drones por alguns segundos de confusão nos sensores inimigos. Deixar uma cidade-isca “queimar” na tela para proteger uma base escondida. Quanto mais radical a decisão, mais material o sistema ganha para aprender.

Nesse ambiente, o campo de batalha do futuro deixa de ser um lugar e vira um espaço de probabilidades. A vitória aparece como porcentagem, empurrada para cima por algoritmos cada vez mais rápidos. E, quanto mais os modelos ficam sofisticados, mais passam a recomendar planos que ninguém teria imaginado sozinho. A virada - silenciosa e decisiva - acontece quando lideranças políticas começam a confiar em padrões que mal conseguem explicar.

Essa transição já tem números fora da ficção. As Forças Armadas dos Estados Unidos fazem exercícios de grande escala, como o Projeto Convergência, alimentando sistemas de IA com fluxos de dados de sensores para coordenar artilharia, drones, satélites e tropas terrestres. Em alguns testes, soluções de tiro geradas por IA surgiram em segundos - no lugar dos muitos minutos que equipes humanas levariam. Em guerra, isso equivale a “roubar” uma eternidade do relógio.

A China, por sua vez, fala sem rodeios em guerra intelligentizada - não apenas digitalizada. A doutrina aponta para conflitos em que aprendizado de máquina assume alvos, logística e engano em uma escala que nenhum estado-maior conseguiria acompanhar. Na Europa, avançam projetos de “ala leal”: aeronaves guiadas por IA pensadas para voar ao lado de pilotos humanos e, mais adiante, operar sem eles. A mensagem converge: vantagem é de quem automatiza mais - e mais depressa.

No papel, humanos seguem “no circuito”. Comunicados oficiais adoram essa expressão. Na prática, quando alertas disparam, redes são bloqueadas e mísseis estão a caminho, ninguém no poder vai ler uma análise de risco com 60 páginas. O que chega à mesa é uma recomendação em vermelho ou verde. E essa recomendação terá sido moldada por anos de guerras simuladas, por uma IA treinada para maximizar “vitória” em mundos onde ninguém sangra de verdade.

Jogos de guerra com IA e combate simulado: quando “boa estratégia” muda de significado

IA em combate simulado não serve apenas para avaliar armas; ela altera a própria ideia do que é uma estratégia “correta”. Sistemas de aprendizado de máquina são especialmente bons em vasculhar opções estranhas, aquelas que a doutrina tradicional descartaria. Eles executam milhões de variações e caçam padrões que humanos nem sabem nomear. Se um algoritmo concluir que abrir mão da defesa de uma cidade aumenta em 3% a chance de vitória nacional, isso entra no registro como caminho “válido”.

A lógica sobe de nível com rapidez. Escolas militares passam a incorporar cenários gerados por IA. Planejadores ajustam premissas sobre escalada, sobre “perdas aceitáveis”, sobre ataques preventivos. E líderes políticos começam a receber gráficos limpos e compensações letais, higienizadas das faces e histórias por trás de cada ponto no diagrama.

Com o tempo, o centro moral das decisões se desloca. A pergunta deixa de ser “devemos fazer isso?” e vira “em quais parâmetros isso se torna ótimo?”. Testes em caixas de areia virtuais normalizam comportamentos que antes seriam impensáveis. A parte mais fria é simples: quando a crise real chegar, esses parâmetros já estarão incorporados no software.

Há ainda um risco pouco discutido: quanto mais países confiam em respostas automatizadas, maior a chance de acidentes por interação entre sistemas “bem-comportados”. Em política internacional, sinais são ambíguos, blefes existem e ruído é regra. Dois conjuntos de algoritmos perfeitamente obedientes, reagindo em cadeia a leituras imperfeitas, podem acelerar uma escalada antes que qualquer gabinete consiga pedir “pausa”.

Como impedir que o ser humano desapareça dentro do circuito

A alavanca concreta que ainda existe está no desenho das regras ao redor desses sistemas. E isso começa bem antes do primeiro disparo, no nível dos dados de treinamento e das restrições embutidas nos jogos de guerra. Cada simulação pode atribuir custo real a mortes de civis, à destruição de infraestrutura e ao caos prolongado no pós-conflito. Ou pode tratar tudo isso, discretamente, como “efeitos colaterais”.

Na prática, significa introduzir atrito deliberado na máquina. Exigir validação humana para classes específicas de ação. Reduzir a autoridade de sistemas que recomendem qualquer coisa envolvendo armas nucleares, biológicas ou ataques cibernéticos contra hospitais e redes civis críticas. Definir linhas vermelhas que a IA não pode cruzar - não importa o quanto o placar simulado insista que isso seria “vencer”.

Também existe uma intervenção cultural que funciona: colocar céticos na sala em sistema de rodízio. Não apenas generais e programadores, mas juristas, especialistas em ética e, sobretudo, pessoas que já viveram sob bombardeio. Gente que olhe para um cenário “bem-sucedido” e pergunte em voz alta: “Você chamaria isso de vitória se sua família morasse aqui?”. Parece suave. Não é.

Um complemento necessário é a fiscalização técnica contínua. Modelos mudam com o tempo, dados novos introduzem vieses e adversários tentam enganar sensores. Auditorias independentes, testes de robustez e avaliações de segurança cibernética não são burocracia: são a diferença entre um sistema limitado e um sistema que, na prática, decide demais por conta própria.

Embora a maioria das pessoas nunca entre nesses laboratórios, a voz pública chega mais longe do que parece. Pressão social já altera política de defesa, ainda que autoridades finjam o contrário. Quando armas autônomas viram manchete, governantes redescobrem a palavra “responsabilidade”. Não é milagre; é custo político aumentando.

Por isso, sim: cartas a parlamentares contam. Perguntas da imprensa contam. Trabalhadores de tecnologia recusando contratos de defesa contam. Quanto mais gente exigir proibições explícitas a decisões letais totalmente autônomas, maior o preço de cruzar essa linha. O mundo já viu isso com minas terrestres e armas químicas: ferramentas repulsivas podem, sim, ganhar estigma e restrição com o tempo.

Sejamos honestos: ninguém lê, ano após ano, 300 páginas de relatórios estratégicos. O que se espalha são ideias simples e medos diretos: “Uma máquina vai decidir quem vive e quem morre?” “Alguém consegue explicar esse sistema em uma frase clara?”. Quando a resposta é não, a confiança desmorona rapidamente. Esse medo não é defeito - é uma das poucas reações sensatas num debate engolido por jargão.

“O perigo real não é um robô assassino rebelde”, comentou comigo, em voz baixa, um ex-analista da OTAN. “É um sistema perfeitamente obediente, otimizado num mundo sem luto, implantado num mundo cheio dele.”

Um pequeno checklist deveria assombrar qualquer conversa sobre IA e guerra:

- Quem assume a responsabilidade legal quando o “melhor movimento” da máquina mata as pessoas erradas?

- Alguma autoridade eleita consegue explicar a lógica central do sistema que acabou de autorizar?

- Civis - e não apenas militares e programadores - participam do debate antes de a tecnologia ir a campo?

Todo mundo já viveu a situação de seguir um GPS por um caminho ruim e, mesmo assim, continuar, porque discutir com a máquina parecia dar trabalho. Agora amplie esse reflexo para um campo de batalha. A confiança na automação avança devagar, um “funcionou da última vez” por vez, até que discordar do algoritmo comece a soar quase irresponsável.

Conviver com a ideia de que as guerras futuras podem escapar das nossas mãos

Depois que você percebe o quanto a IA está entranhada no planejamento militar, fica difícil desver. Você nota quando um líder fala em “ciclos de decisão mais rápidos” como se velocidade e sabedoria fossem inseparáveis. Ouve “dissuasão” e se pergunta se sistemas criados para evitar guerra podem, por acidente, disparar uma - numa escalada rápida demais para qualquer intervenção humana.

Isso não é um apelo para desligar satélites ou jogar fora algoritmos. O mundo não vai voltar a mapas de papel e rádios de campanha. O que permanece em aberto é o espaço entre capacidade bruta e aquilo que aceitamos coletivamente tolerar: se vamos normalizar governos preparando conflitos que ninguém consegue realmente conduzir em tempo real, ou se vamos traçar linhas humanas - imperfeitas, contestáveis, mas humanas.

Talvez a ideia mais inquietante seja também a mais provável: o próximo grande conflito pode parecer anticlimático visto do sofá. Sem anúncio dramático. Apenas falhas, sinais interpretados errado, respostas automatizadas empilhadas umas sobre as outras em uma velocidade que nenhuma sala de gabinete alcança. E, muito antes do alerta de “últimas notícias” no seu celular, a escolha crítica já terá sido tomada por código treinado em uma sala silenciosa e sem janelas.

| Ponto-chave | Detalhe | Por que isso importa para você |

|---|---|---|

| Jogos de guerra com IA moldam a doutrina | Conflitos simulados ensinam forças armadas a preferirem estratégias otimizadas por máquina | Ajuda a entender como “testes” de hoje podem desenhar guerras reais amanhã |

| Humanos correm o risco de virar carimbadores | Lideranças validam recomendações de IA que não compreendem por completo | Levanta perguntas duras sobre responsabilidade e controle democrático |

| A pressão pública ainda faz diferença | Normas, leis e estigmas podem limitar sistemas letais totalmente autônomos | Mostra onde sua voz ainda pode alterar a trajetória dessa tecnologia |

Perguntas frequentes (FAQ)

Já existem armas autônomas em uso hoje?

Sim. Há sistemas que, uma vez ativados, conseguem selecionar e engajar alvos, sobretudo em defesa antiaérea e em munições de espera (as chamadas “munições rondantes”), embora os Estados geralmente insistam que um humano continua, em algum nível, “no circuito”.Por que as forças armadas insistem tanto em IA na guerra?

Pela velocidade, pela percepção de vantagem sobre rivais e pela promessa de reduzir baixas do próprio lado - um pacote muito atraente para quem planeja sob orçamentos apertados e pressão política.O direito internacional consegue mesmo limitar armas de IA?

Consegue, desde que os Estados sintam pressão diplomática e social suficiente. Proibições a lasers cegantes e restrições a minas antipessoal mostram que até ferramentas poderosas podem ser contidas.O maior risco é um “robô assassino” fora de controle?

O risco mais sério é o de sistemas funcionando “corretamente”, mas interagindo dentro de uma política humana confusa e imprevisível, acelerando crises mais rápido do que líderes conseguem reagir.O que uma pessoa comum pode fazer de forma realista?

Apoiar organizações que monitoram armas autônomas, cobrar representantes por linhas vermelhas claras e recusar a ideia de que isso seja apenas um debate técnico reservado a especialistas.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário